全成 “绳上蚂蚱”,OpenAI 是灵珠 or 魔丸?

$OpenAI(OpenAI.NA) 最近真的是忙飞了,一会做电商,一会做社交,现在又推出了浏览器(海豚君点评),emmmm…..七姐妹已经树敌了一半。

三天一个热搜,海豚君简直跟不过来。表面看,OpenAI 风生水起,势要成为改写人类走向的下一代新星。但明星光芒背后,海豚君已经感觉到 OpenAI 的焦虑。

所谓责任越大、压力越大。从 2026 年起,OpenAI 的商业化能力,已经不仅仅是初代投资人的诉求,还成为了万亿产业链的生死寄托。而吹起的估值泡泡,则要求更为苛刻,估值本身有时间成本的折损,因此考验的并不只是商业化的规模,更需要这个规模增长的斜率,一旦斜率放缓,就算产业还在进步,那么估值泡泡会率先刺破。90 年代末的互联网股灾剧本,早就写好了。

话虽如此,海豚君也不希望泡泡破裂,毕竟良性可控的泡泡反而有利于新兴产业的发展——估值溢价吸引更多资金,实业才有钱生产扩张来教育市场渗透用户,用户使用后的数据反哺产品进行功能迭代,最终用户体验买单,产业盈利投资人收获回报。

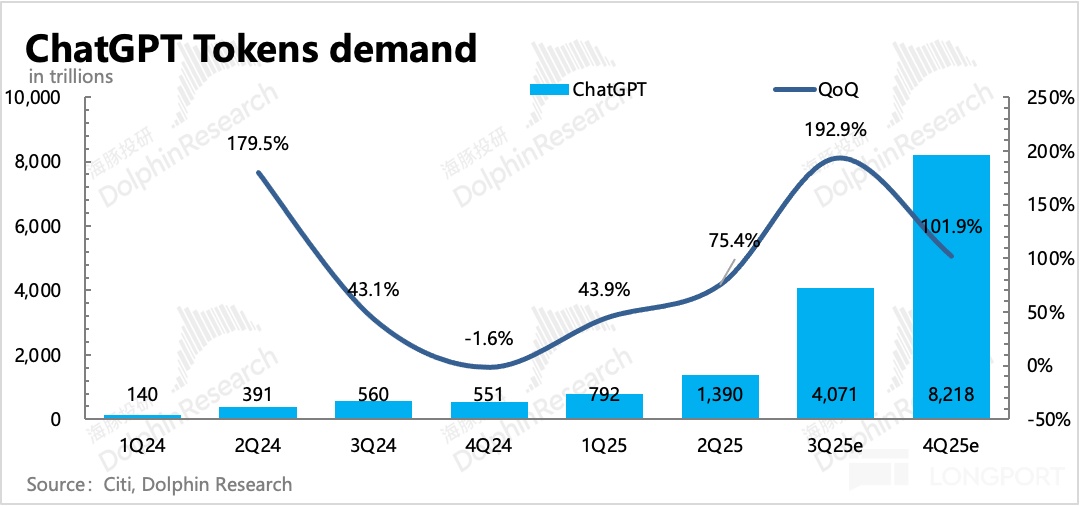

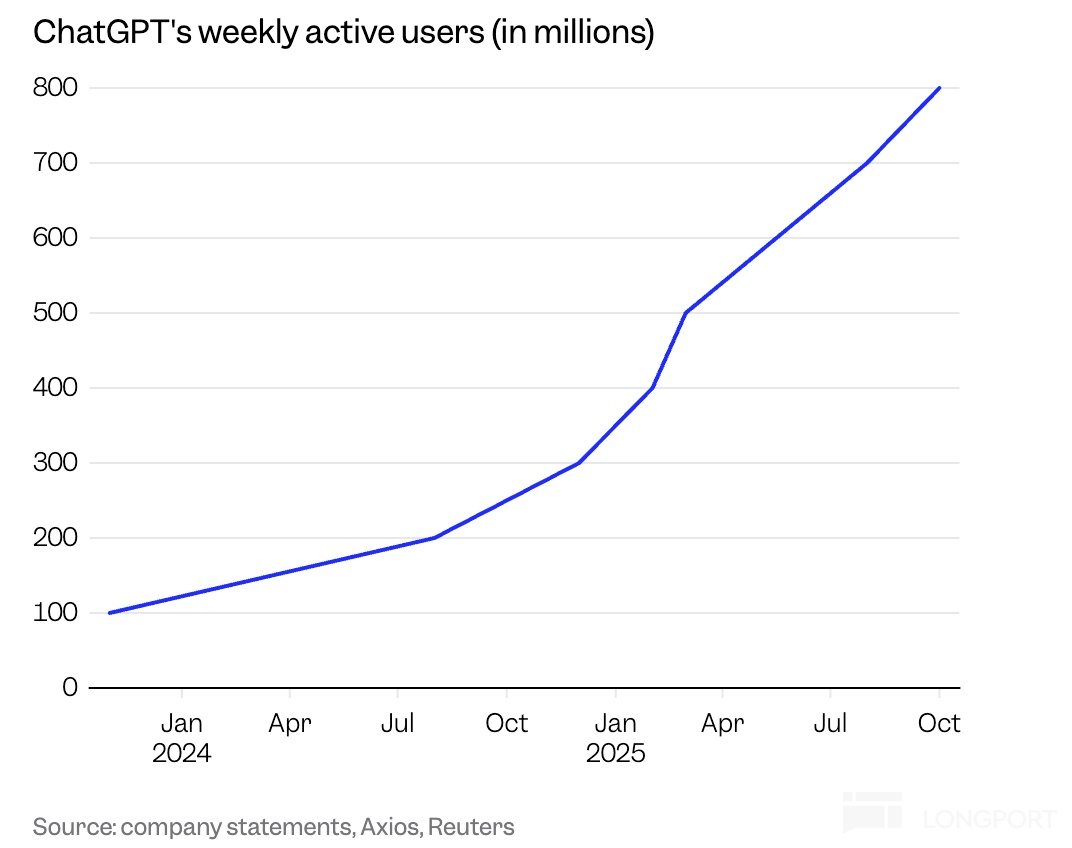

在 OpenAI 收入与投入严重不匹配的情况下,与 OpenAI 有关联的生态圈无疑是产业中最大的风险点,尽管 ChatGPT 已经 8 亿用户规模,用户爬坡速度超过所有已经成功的互联网平台,但比用户规模增长更快的,是背后的算力需求以及 OpenAI 已经订下的供给订单。

趁着这几天 OpenAI 暂时的消停,海豚君先来算算 OpenAI 的账,这全靠资产负债表的扩张,能否在商业化放量之前撑住现金流。以及,后续商业化要做到多少,才能满足后续的高昂算力成本、公司基本运营以及股东要求的回报,公司 2030 年 2000 亿的收入预期够吗?当然,最关键问题是,OpenAI 能否做到?

海豚君将两篇聊聊上述问题,上篇主要 OpenAI 的算力产业链生态以及现金缺口,下篇则估算 OpenAI 的商业化潜力,看看是否有足够的承付能力。

一、OpenAI 的算力 “糊涂账”

1、利益绑死!这错综复杂的生态关系…

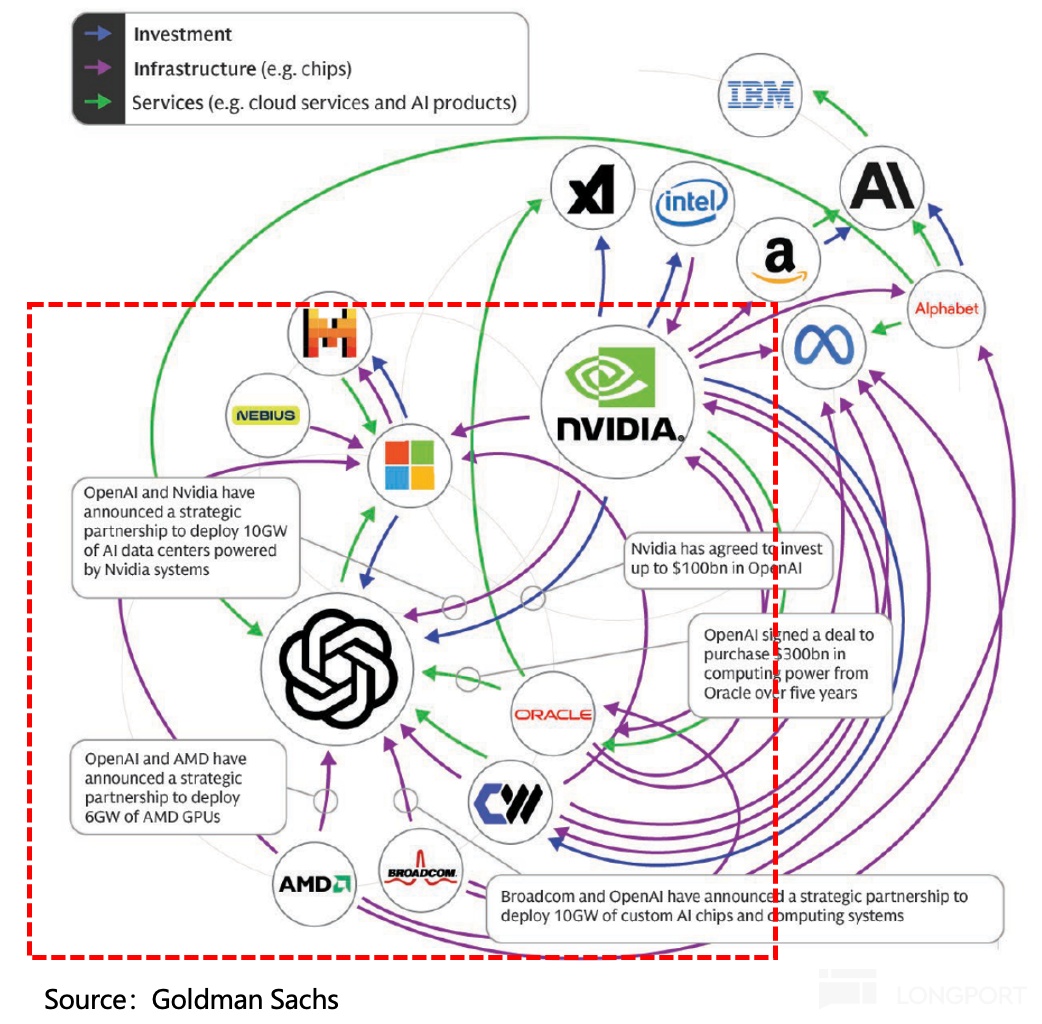

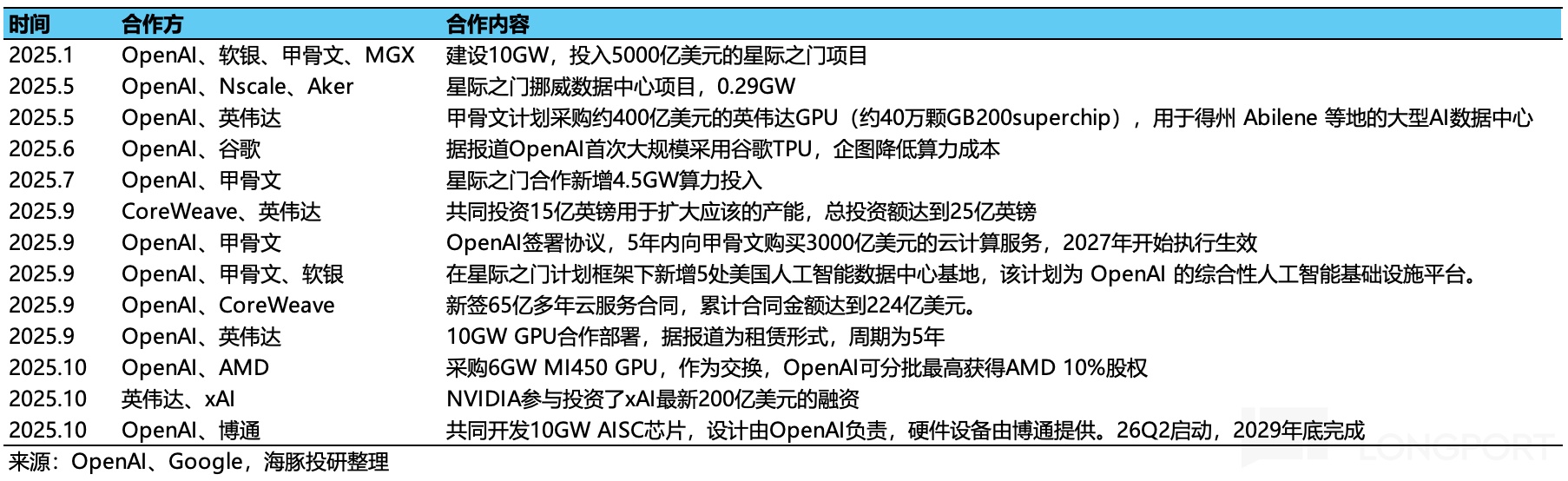

9 月末以来,AI 算力产业链来了一波 “大乱炖”,各家的竞争 or 合作 or 背刺 or 股权关系,简直是剪不清、理还乱。海豚君整理了一下重点新闻,大家也可以先通过关系图感受下这错综复杂的关系。

这其中,OpenAI 绝对是主角中的主角。产业链各家与它的关系,说起来是甲乙方,是战略合作,实际上 OpenAI 已经用这些涉及最高超 30GW 算力的数据中心投资,1.5 万亿美元的生态圈(数据中心总成本 500 亿美元/GW),狠狠套牢了产业链上游的 AI 基建大咖们。

下面海豚君详细来聊一聊:

(1)生态核心:星际之门

最复杂的合作生态,就是 OpenAI 的星际之门项目,它将 OpenAI 与$甲骨文(ORCL.US) 、$英伟达(NVDA.US) 、$软银(9984.JP) 等公司做了深度关联,被市场诟病的 “资金循环”、“算力重复叠加” 就在于此。

最早在 2024 年,媒体报道 Microsoft 和 OpenAI 计划投资 1000 亿打造星际之门(Stargate)AI 超级计算机,将配备数百万个专用服务器芯片,以支持 OpenAI 的 AGI 发展。

当时还是 OpenAI 与$微软(MSFT.US) 蜜里调油的时期。微软累计向 OpenAI 投资了 130 亿,除了股权,OpenAI 给到微软一些技术授权、微软独供 OpenAI 云计算需求、独家代理 ChatGPT 的 API 接口等等。

但进入 2025 年之后,随着 OpenAI 重组完成,OpenAI 与 Microsoft 的关系开始变得微妙了起来,不时有 OpenAI 与微软关系破裂降温的传闻。

这里的核心矛盾在于扩大算力供给的问题。微软作为一家成熟的上市公司,财务严谨是底线,而 OpenAI 一直要求微软快速扩建数据中心,要求数百GW 规模。这让海豚君想起了今年 Sam 的 “惊人” 发言——OpenAI 的发展在 2030 年将需要 250GW 的算力功耗。

250GW 简直是一个微软怎么都吞不下的天量巨饼。一个简单的衡量标准,1GW 功耗相当于 500 亿美金的基建投入要数万亿美金的投入。同时 1GW 相当于 100 万个美国家庭的同时用电,那么 250GW 相当于 2.5 亿个家庭,这美国总人口才不过 3 亿多。。。

眼见 OpenAI 吐槽微软阻碍了它的发展,最终微软让步,将对 OpenAI 推理部分的独家算力供给权放开限制,允许 OpenAI 找别家云平台囤算力。之后 OpenAI 这才找到了后来的 Oracle、Google,找了英伟达、AMD 和博通等等。

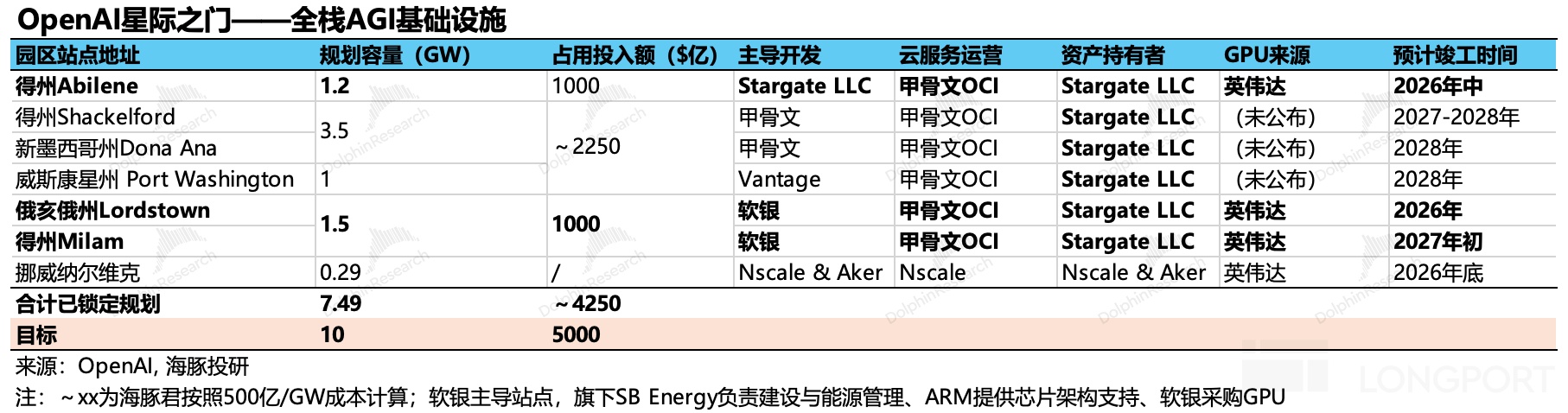

OpenAI 与微软之间的关系也变味了。当初想要让微软帮建的星际之门项目,2025 年初换了投资方之后大大升级,从去年的 1000 亿美元的总投资额上升到未来 4 年投资 5000 亿美元,目标是打造 10GW 算力的数据中心群。

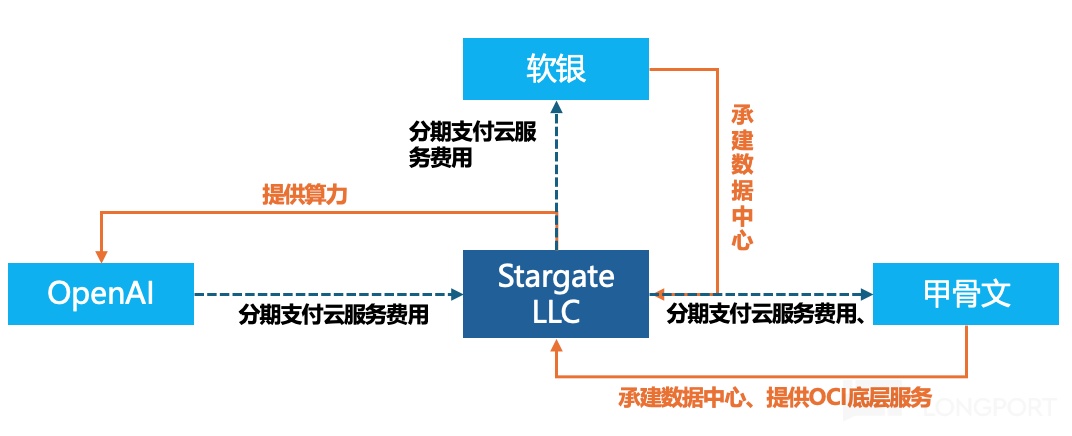

首先 Stargate 从项目成为了一个独立的公司,股东除了 OpenAI 外,换成了 Oracle、Softbank 以及 MGX(阿联酋 AI 投资基金),各自负责数据中心建设运营、能源开发、资金来源,其中 OpenAI、Softbank 分别持有 40% 的股权,Oracle 与 MGX 合计持有剩下的 20%。

这样新成立的公司,从资源禀赋来看,其实就是一个 OpenAI 有绝对话预期的云服务商。这个云服务商数据中心的 GPU 芯片大部分采购于英伟达,尤其是最早开工的 Abilene 是基本全部采用,包括不限于 GB200、GB300 以及 VR200 系列。

9 月底,英伟达又通过分批投资的方式(每部署 1GW 注资 100 亿),总共向 OpenAI“返利” 1000 亿元,并获得相应的 OpenAI 股权(也是分批计算,只要 OpenAI 的估值持续上涨,英伟达持股比例不会大于 10%),来进一步加深了利益捆绑。

而曾经的亲密战友,微软则只是作为其他非参股的技术合作方参与其中,角色地位被明显弱化。

截至当前,部署目标已经规划了 70% 多,主力是美国七个数据中心站点,海外目前有清晰规划主要是挪威地区的站点,大多个数据中心园区的建设都在 2026 年之后竣工。比较快的就是软银主导集群和最先投入的 Abilene 站点,一年后就可投入运营,合计 2.7GW 的算力。

(2)勾搭 AMD:GPU 的 Plan B

10 月初在大家还沉浸在对 OpenAI 与英伟达的甜蜜捆绑津津乐道时,鸡贼的 OpenAI 留了一手,OpenAI 马上宣布未来 5 年将通过云服务商,来部署 6GW 算力的 AMD Instinct 系列 GPU。首批部署为 1GW 的$AMD(AMD.US) Instinct MI450 GPU。也就是通过找备胎的方式,避免因为过度依赖而被裹挟。

作为回报,AMD 向 OpenAI 按照部署节奏分 6 批次发行最多 1.6 亿认股权证(占目前 10% 的股权份额),行权价 1 美分基本等于白送。

同时,行权门槛也不高,虽然只说了首批权证在 1GW 部署完成并供应之后开始生效,但按逻辑讲,后续批次应该也是按照每部署 1GW 可以生效。除了第六批认股权证的行权门槛是 AMD 要达到万亿美金市值(相当于当下股价翻 2 倍)可能会有点难度外,其余认股权证的生效条件,不得不让人怀疑,OpenAI 完全可以通过转股套现来支付采购 AMD 芯片的费用,都不用额外占用太多现金流。

当然,随着 AMD 市值的走高,OpenAI 现金流的支付压力也越小。如果 OpenAI 一直等到 1 万亿,才将所有的认股权证转股卖出,那将获得至少 1000 亿的资金,而 OpenAI 的采购成本估计也就是 1200 亿左右(正常的高端 GPU 功耗下,6GW 对应约 500 万颗 GPU,按每颗 2~3 万美金的综合均价计算)。这样的操作无疑是通过利益捆绑携手做高 AMD 市值为最终目的。

(3)牵手博通:GPU 也有替身

“背刺” 英伟达还不够,OpenAI 干脆找备胎找到底,找到$博通(AVGO.US) 去开发定制 10GW 算力的 ASIC,不过主要用于专有场景的推理。该合作计划从明年下半年启动部署,预计到 2029 年底完成算力建设。

这款 ASIC 设计由 OpenAI 负责,制造、部署和网络集成则由博通提供,和 AMD 一样,这些 ASIC 也将会部署在 Stargate 数据中心以及合作伙伴(如微软、甲骨文)的数据中心中来运行使用。

2、万亿算力投资 “一哄而上”,实则 OpenAI 的平衡术?

结合<1-3>,上述星际之门以及与产业链上游的直接合作,加上最近 9 月刚签的 CoreWeave 合同,OpenAI 给未来的自己累计规划了最高 31GW 算力新增供给(其中 26 亿算 GW 是近一个月新增的),对应产业链总部署价值高达 1.5 万亿。

其中英伟达的 10GW 纯新增,属于 OpenAI 与英伟达直签的租赁合同。预计总租赁成本要比采购芯片便宜 10%-15%,关键从采购改租赁,能帮 OpenAI 减轻资金一次性投入下的现金流负担。

但海豚君认为,甲骨文的 4.5GW 与 AMD、博通的算力规划,只能说不排除有重叠。目前 4.5GW 的新算力需求,甲骨文在 5 月采购过 400 亿美元的英伟达 GPU,这只够对应 1GW 的容量,并且新闻报道了是专门用于得州 Abilene 数据中心的建设。

也就是说,4.5GW 的新增算力,要么从甲骨文目前的存量数据中心挪移算力,要么就是要新建数据中心。这里面涉及到新 GPU 的采购。要么是甲骨文继续从英伟达采购,要么从别处采购。

但 OpenAI 与 AMD、博通的合作也说明了,这部分芯片需要安排部署在 in-house 的数据中心(也就是指 Stargate),或者合作伙伴的数据中心上。这个合作伙伴,应该主要就是指微软、甲骨文。

已知,微软主要负责 OpenAI 的训练算力,甲骨文负责推理算力。因此如果有安排,那么博通的部分应该就是部署在 Stargate(基本都是甲骨文负责运营)或者甲骨文数据中心上。AMD 则可能或许会有几率安排在微软上,这是因为,OpenAI 对 AMD 的合作要求是 2026 年底才会推出的 MI450,旨在用于训练上。

这 30GW 的算力负载,占到了美国 2024 全年数据中心总装机量的 60%。70% 利用率运行下,换算成 Tokens(按照 H100 GPU,7B-70B 不同大小的推理模型来算)大约可以达到 10~378 万万亿/年,是 2025 年 OpenAI 14000 万亿 Tokens/年的 7~200 倍。

虽然 OpenAI 的梦想非常宏大,以后万物皆 AI,算力还会飞速增加,但关键是这又大又圆的算力需求,又为什么急于在一个月之内锁定协议和合作对象呢?

海豚君认为,整个过程完全可以归于利益博弈。但看似是 OpenAI 焦虑算力供给,实则可能是一种平衡术,旨在提前锁死关键伙伴,壮大整个生态。

(1)甲骨文上牌桌:是福,还是祸?

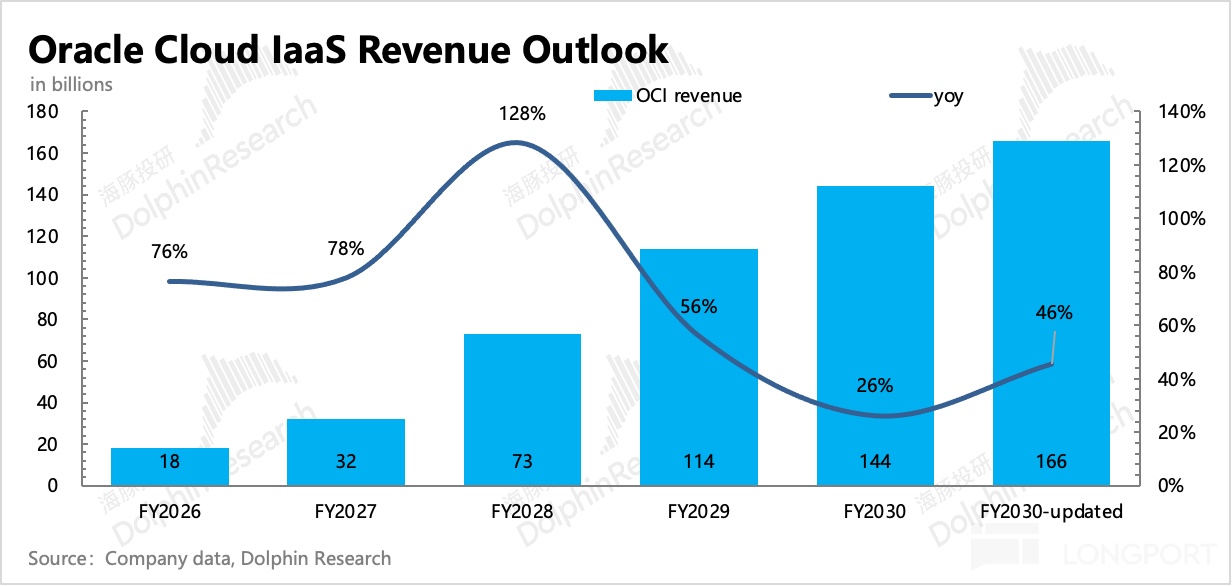

作为与 OpenAI 捆绑最深的一方,甲骨文也是赌上身家了。好的是,未来的收入增长几乎由 OpenAI 决定,OpenAI 也会尽可能把最多的算力需求订单给到它,比如 27 年开始的 5 年 3000 亿订单。这才有了 Q2 业绩会上 “炸裂” 的长期增长指引,以及 AI World 大会上的 “任性” 上调:

但同时作为 Stargate LLC 的股东,为了推动项目要能正常开展,当前期投入的资金不够时(若 OpenAI 未及时融来足够的资金),只能咬碎牙先垫资,尤其是它负责主导建设的两个数据中心园区,不排除需要先自掏腰包去先买下 GPU 芯片以及其他辅助硬件。然而,甲骨文也并不富裕,资产负债率 80%,作为没有现金流主业的数据中心开发运营商,重资产运营下,现金储蓄也并不多。

除次之外,OpenAI 还与英伟达签了直租合同,这就让甲骨文有点尴尬了。而从趋势上看,Stargate 未来的闲置算力不排除会对外出租(30GW 只是峰值需求,并非常态)。

虽然甲骨文握手 Stargate 的少部分股权,但不妨碍业务本身存在竞争,到时候甲骨文很可能会成为 Stargate 的包工头/运维/分销商,彻底锁死 OpenAI,要么就是退出 Stargate 联盟,但无论哪一种,都不是特别好的归宿。

(2)英伟达:与 CSP 巨头争夺产业话语权

此次英伟达于 OpenAI 的 10GW 直接合作,实际上是在谷歌、甲骨文傍上 OpenAI 后,英伟达一种进击式防守,尤其是谷歌还用的是 TPU。在当下的算力产业链中,由于还是供小于求的卖方市场,因此中上游正在美美享受行业发展的红利。但二者之间也存在明争暗斗,尤其是各自的巨头,谁也不服谁。

中游 CSP 想削掉上游 GPU 的高昂采购成本,上游 GPU 眼红中游 40% 的利润蛋糕。但若下游需求巨头选择捆绑其中一方,这一方的产业链溢价权自然上升。尤其是当面对拥有 8 亿周活用户的 OpenAI,无论是发展前景还是背后资源实力上,都会吸引芯片巨头锁死利益关系,“一起为梦想窒息!”。

或者说芯片厂商只能相信,OpenAI 允诺的天量订单,给三家芯片厂商带来的营收增量都是史无前例的,如果不去相信,否则如何去讲自己的增长故事?所谓船大、饼大,这个抱团意愿也就可想而知了。

再加上这笔交易本身,对英伟达也是不亏的。不仅仅是 1000 亿的投资是分批投入,就算把这 1000 亿算到成本中,对于英伟达来说也是净赚的,只是毛利低了点:

据报道租赁成本相比采购成本便宜 10%-15%,即 350*85%=300 亿/GW,再扣去 “返现” 的 100 亿/GW,实际净付 200 亿/GW,英伟达正常成本 350*25%=87.5 亿,调整后毛利为 112.5 亿,调整后毛利率 32%,比之前少赚 150 亿/GW。

但是英伟达用这部分让利出去的毛利率锁定了最高 10% 的 OpenAI 股权,一定程度上相当于用实物作为风险投资的资本来换取股权。

但如果没有租赁模式和这 1000 亿的投资,也不一定换的来 10GW 的订单,订单更多被流入到博通、AMD 等竞对口中。最终这场投资变成了芯片商们 FOMO 的博弈平衡。

(3)AMD:是备胎又怎样?毕竟上船了

AMD 毫无疑问是 OpenAI 的备胎,是 OpenAI 面对英伟达留有的后手,但也注定了只有在一定条件下才会转正(MI450 成功推出、额外算力部署)。

从订单总金额与目前的收入规模来看,弹性很高。一边是五年 1000 多亿的收入订单,一边是万亿市值梦,看上去 OpenAI 与 AMD 合作是 win-win。

但 AMD 也是分批部署,一次 1GW,但也需要上百亿的前置投入。这笔钱在完成部署之前,OpenAI 可能并不能预付 100%,这就需要 AMD 垫资了。不过往好处想,正是因为是备胎,因此算力需求不太会立即分配到它,就算垫资,规模也相对可控。

(4)博通:大势所趋的渔翁

虽然市场认为博通的不确定性最高,毕竟合作细节披露得最少。但海豚君认为,产业链中 CSP 与 GPU 芯片巨头之间利益博弈,比如英伟达直接绕过 CSP 与下游客户 OpenAI 签直供合同,等于是要把 CSP 大厂们排除出利益链条外,这必然会加速 CSP 自研 ASIC 芯片的进程。而博通通过多年与谷歌 TPU 的合作,这套程序已经相当熟练,毫无疑问是受益。虽然从目前来看,OpenAI 暂时还不急于依赖 ASIC 的算力,但自研芯片正是渗透到 CSP 的后一步。

三、万亿投资,钱从何来?

OpenAI 上述已囤的 31GW 算力峰值,撑起的是 1.5 万亿的产业链价值。但这只是多年之后预计的 “最高” 投入成本,而非短期投入抑或是最终累计投入,导致市场非常担心 OpenAI(2025 年收入可能是 150 亿美金)的支付压力。

实际上,OpenAI 购买星际之门的云服务,其实就相当于星际之门的下游客户,按照实际使用来支付费用。如下图,真正承担投入资金职责的是 Staragte 这个合资公司,虽然 OpenAI 有 40% 的股权,也要承担一定责任,但总归可以找人分担了。

但市场也担心,除了 OpenAI 之外,共同责任人软银、甲骨文、WAX 是否有承付能力,毕竟这几家都没啥巨额的稳定现金流。

海豚君认为,担心并非多余。但实际的承付压力,还得算一算。这里面到底有多少缺口,是需要 OpenAI 的商业化或再融资来补上的,甚至是甲骨文等需要长期垫资的。

OpenAI 的整体规划周期基本在 5 年,虽然都是分批付款:英伟达是 5 年租赁合同(跳过 CSP 直租),AMD 和博通都是按实际部署节奏来付款,AMD 还附带送股套现,甲骨文也是 5 年租期,CoreWeave 同样是多年租期。

但似乎叠加起来,对短期的现金支付要求压力依旧不小。

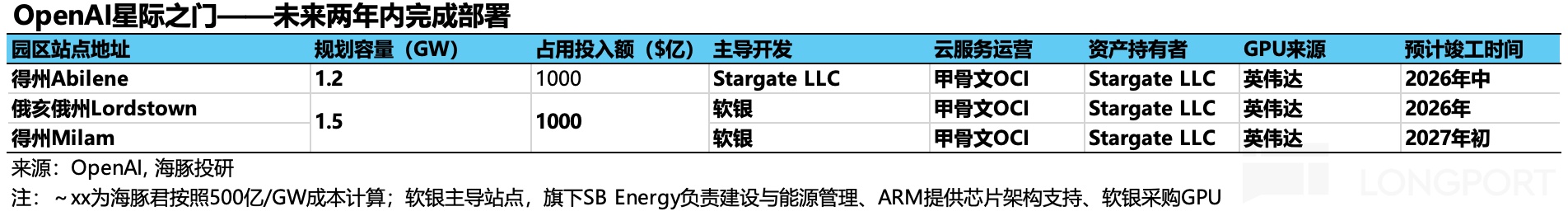

(1)数据中心投入:尤其是按目前计划,星际之门里三个数据中心(得州 Abilene、俄亥俄州 Lordstown、得州 Milam)都将在未来两年内完成部署落地。这也意味着付款周期马上来临,这是整个星际之门背后项目方(OpenAI、Oracle、软银、MGX)所面临的共同压力。

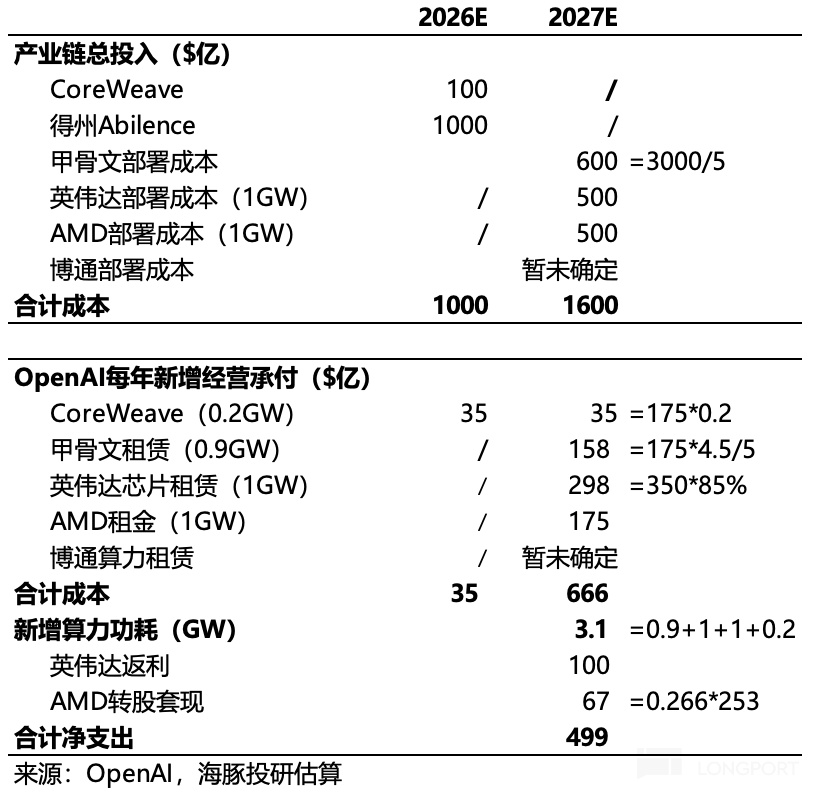

(2)除此之外,英伟达的首批 1GW、AMD 的 1GW 也将在 1 年内完成部署,分别对应 350*85%(租金优惠)=298 亿、500 亿美元部署成本(其中芯片成本 175 亿美元)。

(3)甲骨文的 3000 亿 4.5GW 算力订单,将在 2027 年开始支付 600 亿美元。

上述 1-3 合计,OpenAI 所代表的 Stargate,将于 2027 年需要支付 1600 亿美元。而真正落到 OpenAI 头上的,则是按需租赁算力的费用,以及前置投入中分派到自己头上的成本,合计 600 多亿。

但英伟达的 100 亿投资、AMD 的首批权证转股(2660 股)套现后也有 60 多亿(按当前股价来算,实际降息周期下,估值抬高套现额也会一同提升),减去后最终净支出为 500 亿美元。注意这里仅计算了与新合作伙伴的投入,与微软原本的云服务采购也在继续。(因为实际情况不确定,具体细节不清晰,下图估算比较粗略,仅供大致参考)。

目前 Stargate 首期资金 1000 亿,其中 OpenAI、Softbank 作为主导人,首期 1000 亿资金双方各投资 190 亿美元,甲骨文和 MGX 联合投资 70 亿,剩下的 550 亿计划通过发债融资。

这里面的关键支撑点,就是 OpenAI 未来是否有这样的商业化能力,去兑现这些价值万亿的天量订单?

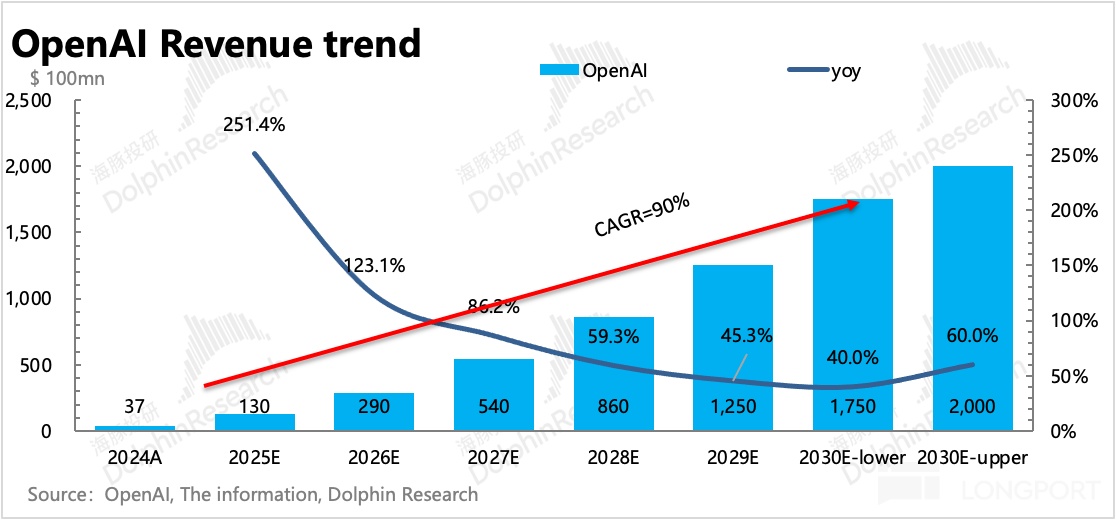

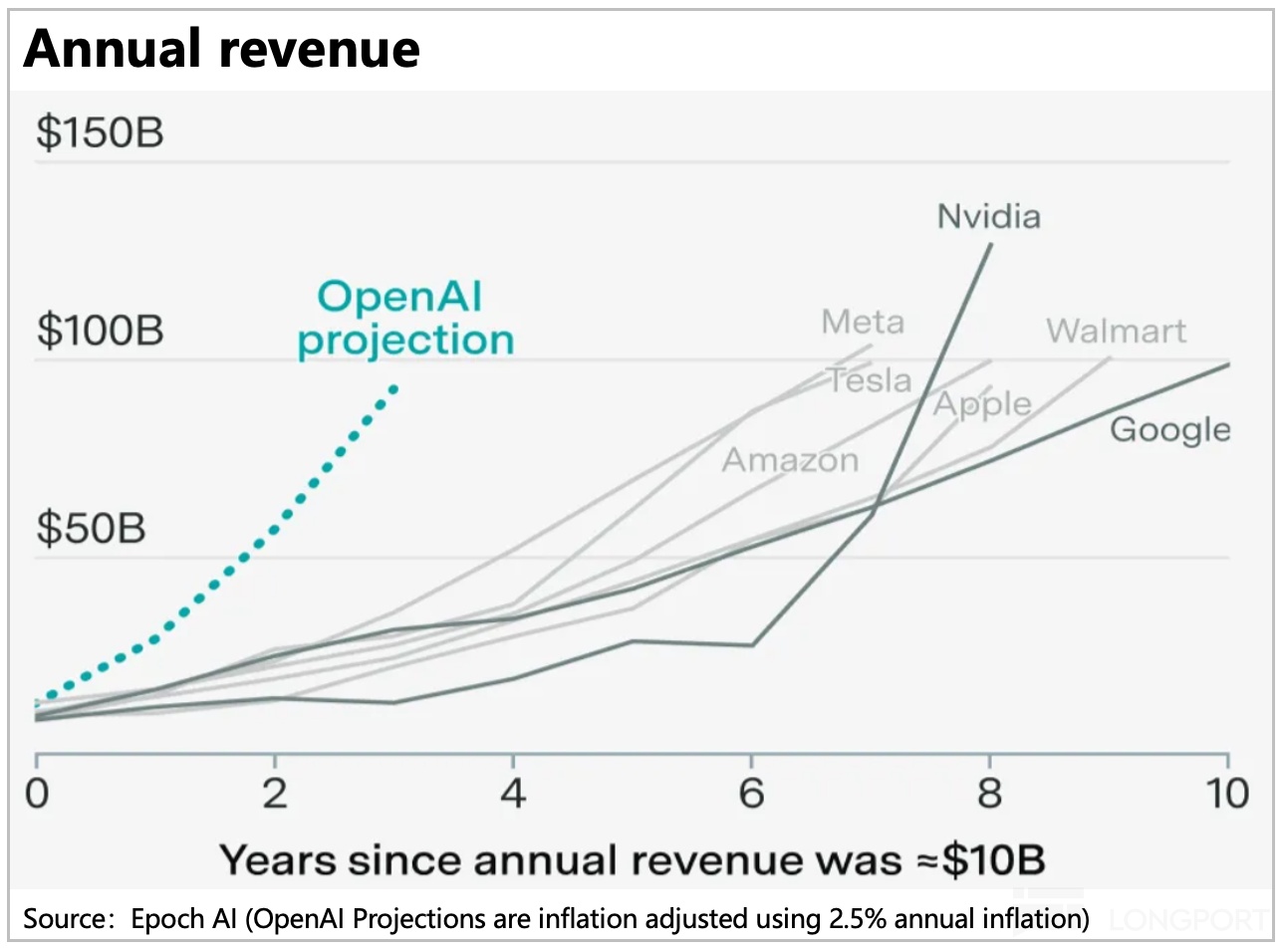

面对承付能力质疑,OpenAI 的商业化展望是这样的:2025 年预计营收 130 亿(隐含下半年收入 87 亿,环比 100% 增长),2029 年目标 1250 亿,2030 年目标 1740-2000 亿,未来 5 年 CAGR 超过 90%。

在上述 2027 年的支出测算下,预期 540 亿的收入刚好覆盖新增算力成本,但还有研发人员、营销投入以及公司基本运营支出需要覆盖,这部分大约占到收入的三分之一,也就是 150-200 亿之间。

这个缺口只能寄希望于再融资,但问题是,OpenAI 的 5 年 2000 亿的宏大收入愿景能实现吗?

5 年 10 倍收入增长,而且是起点就已经在百亿级别,绝对是难度拉满。换种说法,5 年营收从 0 干到 1000 亿。放眼望去过去几十年,也只有在 AI GPU 领域做到 90% 以上绝对通吃且身处产业链中价值最高的芯片设计环节的英伟达,才有过这样的 “增长斜率”。

不过,正如当初的 ChatGPT 横空出世,从当初的质疑到最后的信服,成为 AI chatbot 的专属代名词,那么 OpenAI 能否复刻 ChatGPT 的神话?下一篇,海豚君将深入探讨 OpenAI 的收入端——商业化前景,以及对现有巨头的潜在影响大小。敬请期待!

交易商排行

更多- 监管中EXNESS10-15年 | 英国监管 | 塞浦路斯监管 | 南非监管89.22

- 监管中VSTAR塞浦路斯监管| 直通牌照(STP)80.00

- 监管中FXTM 富拓10-15年 |塞浦路斯监管 | 英国监管 | 毛里求斯监管85.21

- 监管中axi15-20年 | 澳大利亚监管 | 英国监管 | 新西兰监管82.15

- 监管中GoldenGroup高地集团澳大利亚| 5-10年85.87

- 监管中Moneta Markets亿汇澳大利亚| 2-5年| 零售外汇牌照75.97

- 监管中GTCFX10-15年 | 阿联酋监管 | 毛里求斯监管 | 瓦努阿图监管63.65

- 监管中IC Markets10-15年 | 澳大利亚监管 | 塞浦路斯监管91.81

- 监管中markets4you毛里求斯监管| 零售外汇牌照| 主标MT4| 全球展业|82.31

- 监管中CPT Markets Limited5-10年 | 英国监管 | 伯利兹监管92.61