AI定制芯片的风口:业绩将至,博通能否挑战英伟达霸权?

TradingKey - 大型语言模型(LLM)正在从“训练”阶段逐步过渡到“推理”阶段,人工智能算力基础设施的需求结构发生深刻变化。同时,越来越多的大型科技及云计算公司迫切寻求性能更高、成本更低的AI芯片替代方案,从而推动 了定制化ASIC(专用集成电路)市场的快速崛起。在这一变革潮流中,Broadcom(博通)与Marvell成为ASIC市场的两大领军者。

博通在自研AI加速器(XPU)与网络芯片方面均建立了领先优势。其中,以Tomahawk与Jericho为代表的以太网交换芯片,专为AI数据中心优化,支持高达800Gbps的数据传输速率,具备极低延迟,确保AI加速器之间的高效协同。此外,这一产品线广泛部署在Amazon、Google、Meta、微软、阿里巴巴等超大型云服务商的数据中心中。

2025年起,博通更取得OpenAI关键订单,成为其AI ASIC解决方案的核心供应商。华尔街推测,目前博通客户名单可能还包括Arm Holdings、苹果、马斯克旗下AI Lab,以及尚未披露的另一家超大型企业。

强劲财报预期

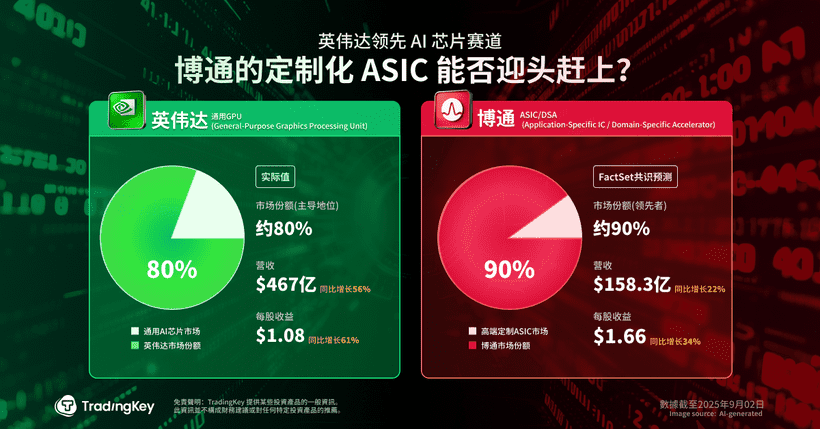

博通将于9月4日盘后发布2025财年第二季度财报。根据FactSet预测,公司本季度营收将达158.3亿美元,同比增长22%;每股收益(EPS)预期1.66美元,年增达34%。相比之下,Marvell近期财报没能让投资者信心十足,导致其股价重挫,也再度拉高市场对博通业绩的关注度。

尽管英伟达强劲财报带动整个AI概念大涨,但分析师普遍认为,市场对AI硬件厂商的预期极高,仅靠“符合预期”难以继续催化股价表现,若博通无法在指引或增长前景上超越预期,财报后的反应可能面临挑战。

ASIC的成本与效率优势凸显

在当前阶段,AI芯片的推理阶段需求迅速增长,而正是这一环节,ASIC的优势比通用GPU尤为显著。相比用于普适计算的GPU,ASIC能够精准执行面向特定神经网络结构的矩阵运算,避免大量无效计算,有效降低能源消耗与冷却成本。

据此前花旗的报告,每颗ASIC芯片成本仅约5000美元,而Nvidia的主流产品H100每颗售价可达2万至3万美元。在能耗方面,H100的功耗高达700W,而ASIC在等效任务上的能效更优,功耗平均可降低30%。因此,从企业角度来看,未来统筹数据中心建设的TCO(总体拥有成本)时,采用ASIC约有75%的成本节省空间。

需求爆发:市场规模或达900亿美元

公司预计到2027年全球AI ASIC市场规模将达600亿至900亿美元,其AI相关收入年复合增长率可达60%,而英伟达当前预期的50%。

不过,考虑到当前ASIC业务中XPU(AI加速处理器)所占比重较高,受其初期盈利能力影响,博通整体毛利率短期承压。预计2025财年毛利率环比将下降约1.3个百分点。但中长期来看,随着设计迭代和良率提升,毛利率有望渐进修复。

博通与英伟达的博弈

尽管英伟达目前在生态系统构建(CUDA开发工具、软件兼容性等)方面遥遥领先,但博通正逐步弥补差距。更引人关注的是,据市场消息,英伟达近来也悄然成立ASIC研发部门,显示出其对未来“定制芯片趋势”的重视。

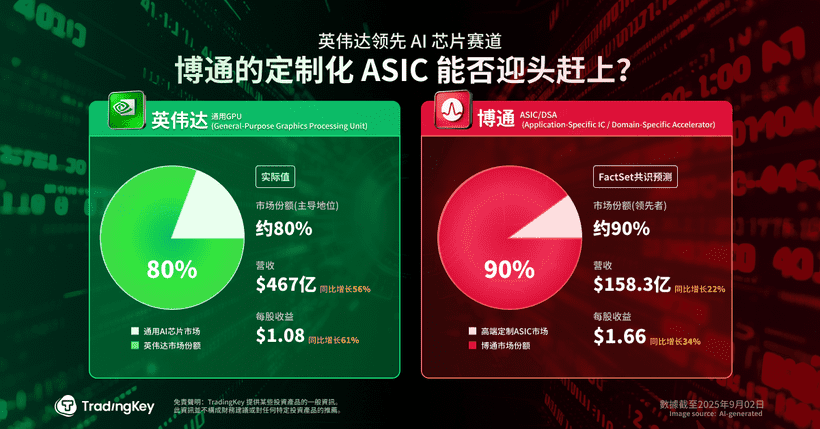

从牧本定律(Makimoto’s Wave)来看,半导体发展常在“通用化”与“定制化”两者之间10年周期性振荡。十年前,AlexNet算法横空出世,推动GPU(尤其是英伟达GPGPU)销量飞跃。而今潮水或再次转向:博通正在推动以性能、成本和功耗优化为核心的ASIC解决方案进入更多前沿场景。当然,两者并不是非此即彼的关系。

投资视角:估值合理,自由现金流亮眼

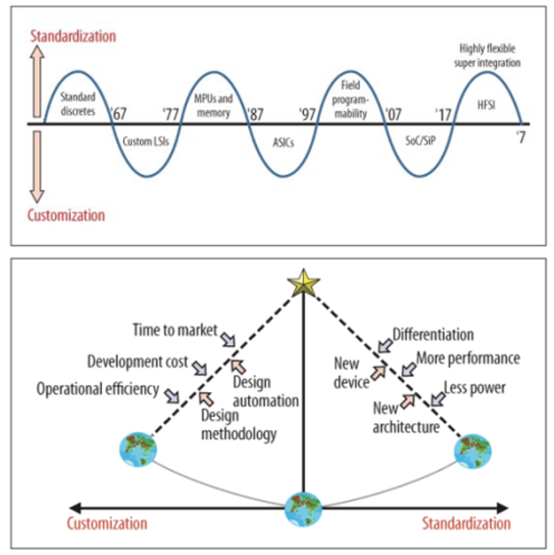

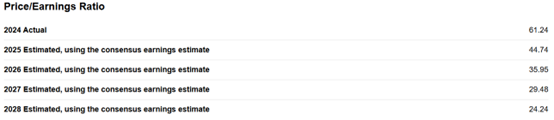

从估值角度看,目前博通的动态PE 40倍左右,虽存在一定溢价,但较英伟达50–60倍的水平仍具吸引力。公司现金流表现强劲,在成功整合VMware之后,自由现金流已在2025年Q2达到64.1亿美元,同比增长44%。

根据Seeking Alpha数据,博通2025至2028年前瞻PE持续下降,估值将逐步回归合理区间。如Melius Research所言:“面对短期波动,任何疲弱都是逢低布局的良机,因为在英伟达之外,市场极度缺乏具规模领先力的AI基础设施公司。”

交易商排行

更多- 监管中EXNESS10-15年 | 英国监管 | 塞浦路斯监管 | 南非监管89.22

- 监管中VSTAR塞浦路斯监管| 直通牌照(STP)80.00

- 监管中FXTM 富拓10-15年 |塞浦路斯监管 | 英国监管 | 毛里求斯监管85.21

- 监管中axi15-20年 | 澳大利亚监管 | 英国监管 | 新西兰监管82.15

- 监管中GoldenGroup高地集团澳大利亚| 5-10年85.87

- 监管中Moneta Markets亿汇澳大利亚| 2-5年| 零售外汇牌照75.97

- 监管中GTCFX10-15年 | 阿联酋监管 | 毛里求斯监管 | 瓦努阿图监管63.65

- 监管中IC Markets10-15年 | 澳大利亚监管 | 塞浦路斯监管91.81

- 监管中markets4you毛里求斯监管| 零售外汇牌照| 主标MT4| 全球展业|82.31

- 监管中CPT Markets Limited5-10年 | 英国监管 | 伯利兹监管92.61